Die Elefantenherde im Raum: Warum ein KI-Videokurs nicht reicht

Künstliche Intelligenz ist kein isoliertes Thema, das man einmal im Jahr „herunterschulen“ kann. Sie ist kein neues Werkzeug im Schrank, sondern sie verändert die Art und Weise, wie der Schrank überhaupt gebaut wird.

Es ist ein vertrautes Ritual in fast jedem Betrieb: Einmal im Jahr ploppt die Erinnerung für die obligatorische Datenschutzschulung oder die Arbeitssicherheitsunterweisung im Postfach auf. Das Team seufzt leise, klickt sich durch ein einstündiges E-Learning-Modul, setzt am Ende das rettende Häkchen und widmet sich wieder dem eigentlichen Tagesgeschäft.

Versteh mich nicht falsch: Diese etablierten Compliance-Prozesse sind das absolute Fundament eines sicheren Betriebs. Die Kolleginnen und Kollegen, die diese Themen im Hintergrund organisieren, leisten essenzielle Arbeit, um das Unternehmen vor Schäden zu bewahren. Doch weil wir es gewohnt sind, neue rechtliche Anforderungen einfach in das nächste „Häkchen-setzen-und-vergessen“-Modul zu packen, tappen wir bei der Künstlichen Intelligenz gerade kollektiv in eine gefährliche Falle.

Die neue Dimension des Lernens

Künstliche Intelligenz ist kein isoliertes Thema, das man einmal im Jahr „herunterschulen“ kann. Sie ist kein neues Werkzeug im Schrank, sondern sie verändert die Art und Weise, wie der Schrank überhaupt gebaut wird. Wenn wir versuchen, den sicheren Umgang mit KI mit einem schnellen Videokurs abzufrühstücken, übersehen wir die sprichwörtliche Elefantenherde im Raum.

Der größte dieser Elefanten betrifft nämlich nicht die Belegschaft, sondern die Führungsebene.

Viele Unternehmen agieren aktuell noch so, als befänden wir uns in einer unverbindlichen Experimentierphase. Ein bisschen ChatGPT hier, ein wenig Copilot da. Doch die rechtliche Realität hat uns längst überholt. Der EU AI Act fordert den Aufbau von echter KI-Kompetenz – der sogenannten „AI Literacy“ – nicht nur von den Anwendern, sondern ganz explizit auch von der Geschäftsführung.

Es reicht nicht mehr, die Verantwortung an die IT-Abteilung oder einen externen Trainer zu delegieren. Wer die strategische Tragweite dieser Technologie nicht versteht, kann sein Team nicht sicher durch den Wandel führen. AI Literacy ist keine lästige Pflichtaufgabe für zwischendurch. Sie ist das neue Betriebssystem für zukunftssichere Führung.

Mehr als ein Software-Kurs: Warum das „Mäuseballett“ der Klicks nicht reicht

Wenn die strategische Verantwortung der Geschäftsführung die Elefantenherde ist, dann ist unser aktueller Umgang mit KI-Schulungen oft ein reines Mäuseballett. Wir konzentrieren uns auf die kleinen, flinken Handgriffe: Wo genau finde ich den neuen Copilot-Button in Word? Wie schreibe ich einen Befehl, der mir in zehn Sekunden eine höfliche Kunden-E-Mail formuliert?

Das ist alles nett und spart im ersten Moment Zeit. Aber es hat mit echter „AI Literacy“ (KI-Kompetenz) herzlich wenig zu tun.

AI Literacy bedeutet nicht, die Benutzeroberfläche einer Software bedienen zu können. Es bedeutet, die Mechanik darunter zu verstehen. Wie „denkt“ diese Maschine eigentlich? Warum erfindet sie manchmal extrem überzeugend klingende Fakten (sogenannte Halluzinationen)? Und vor allem: Nach welchen unsichtbaren Mustern bewertet sie Daten?

Gerade der letzte Punkt – der sogenannte Bias (Voreingenommenheit) – ist entscheidend. Unternehmen, die sich gerade intensiv mit dem Barrierefreiheitsstärkungsgesetz (BFSG) auseinandersetzen, wissen längst: Inklusion, Fairness und digitale Teilhabe enden nicht bei der barrierefreien Website. Sie gelten erst recht für die Algorithmen, die wir unbewusst in unsere täglichen Entscheidungsprozesse einbinden. Wer die Vorurteile der Maschine nicht erkennt, reproduziert sie.

Die rechtliche Realität: Der 2. Februar 2025

Und hier wird es ungemütlich. Viele Betriebe glauben, sie hätten noch Zeit bis irgendwann Ende 2026, um sich mit den Regeln des EU AI Acts zu beschäftigen. Ein fataler Irrtum.

Artikel 4 des Gesetzes, der genau diese AI Literacy von Anbietern und Betreibern fordert, ist bereits seit dem 2. Februar 2025 geltendes Recht. Und zwar für alle KI-Systeme, völlig unabhängig von ihrer Risikoklasse.

Anders als beim klassischen Datenschutz, wo im Ernstfall oft die saubere Prozessdokumentation und die unterschriebene Teilnehmerliste der letzten Schulung den Kopf aus der Schlinge ziehen, fordert der AI Act den Nachweis der tatsächlichen Kompetenz. Ein Zertifikat über ein einstündiges „KI-Grundlagen“-Webinar ist das Papier nicht wert, auf dem es gedruckt ist, wenn die Mitarbeitenden die Risiken der Technologie in ihrem spezifischen Arbeitsalltag nicht bewerten können.

Die Illusion der fertigen Schablone: Warum „Quick Fixes“ im Alltag scheitern

Weil der rechtliche Druck seit Februar 2025 real ist und der Arbeitsalltag ohnehin schon aus allen Nähten platzt, suchen viele Unternehmen nach der schnellsten Abkürzung. Das Internet ist voll davon: „Die 50 besten Prompts für HR“, „Kopiere diese Befehle und spare 10 Stunden pro Woche“.

Es ist extrem verlockend, sich diese fertigen Schablonen herunterzuladen, sie dem Team ins Intranet zu stellen und das Thema KI-Kompetenz damit geistig abzuhaken. Doch genau hier zeigt sich der Unterschied zwischen dem oberflächlichen „Mäuseballett“ und echter AI Literacy.

Ein kopierter Befehl ist keine Strategie. Wenn wir fertige Prompts unreflektiert übernehmen, passen wir unsere Arbeitsweise an die Maschine an – und nicht umgekehrt. Jedes Unternehmen hat seine eigene DNA, eigene Qualitätsstandards und eine spezifische Art, mit Kunden zu kommunizieren. Eine Schablone, die für eine hippe Marketingagentur funktioniert, ist für einen mittelständischen Maschinenbauer oder eine Pflegeeinrichtung im Zweifel völlig unbrauchbar oder sogar rufschädigend.

Die Klaviatur der Delegation

Echte KI-Kompetenz zeigt sich darin, dass wir aufhören, nach dem einen perfekten Standard-Befehl zu suchen. Stattdessen müssen wir lernen, die „Klaviatur der Delegation“ zu spielen.

Das bedeutet, für jeden Prozess im Betrieb bewusste Entscheidungen zu treffen:

- Welche repetitiven Aufgaben geben wir komplett an die Maschine ab?

- Wo nutzen wir die KI gezielt als Sparringspartner für erste Entwürfe, die wir dann mit unserer menschlichen Expertise veredeln?

- Und an welchen Stellen – etwa bei sensiblen Personalentscheidungen oder komplexen Kundenberatungen – ist menschliches Mitdenken und Empathie absolut zwingend und der KI-Einsatz tabu?

Am Ende verdichtet sich AI Literacy auf eine einzige, zentrale Frage, die jedes Team für sich beantworten muss: Wer führt hier eigentlich wen?

Nutzen wir die Technik als mächtiges Werkzeug, das unseren eigenen Zielen dient? Oder ordnen wir uns schleichend den vorgegebenen Mustern der Software unter, weil wir nicht genau verstehen, was sie im Hintergrund tut?

Der Countdown läuft: August 2026 und die Hochrisiko-Falle

Wenn die Antwort auf die Frage „Wer führt hier wen?“ im Betriebsalltag unklar bleibt, wird es gefährlich. Und zwar nicht in einer abstrakten Science-Fiction-Zukunft, sondern beim nächsten ganz banalen Software-Update.

Stell dir folgende, absolut alltägliche Situation vor: Dein Team ist ausgelastet, eine neue Stelle ist ausgeschrieben und das Postfach quillt über mit Lebensläufen. Jemand aus dem Team möchte proaktiv Zeit sparen und nutzt die neue, blinkende KI-Funktion in Microsoft 365, um die Bewerberinnen und Bewerber in einer Excel-Tabelle nach Qualifikationen vorzusortieren. Ein Klick, eine schnelle Erleichterung im Stress.

Was sich wie ein smarter Effizienz-Boost anfühlt, ist in Wahrheit eine tickende Compliance-Zeitbombe.

Während die grundlegende Pflicht zur AI Literacy bereits seit Februar 2025 gilt, zieht der EU AI Act im nächsten Schritt die Daumenschrauben für konkrete, kritische Anwendungsfälle an. Ab dem 2. August 2026 greifen die strengen Regeln für sogenannte „Hochrisiko-KI-Systeme“ (Annex III). Und der Gesetzgeber ist hier unmissverständlich: Der Einsatz von KI im Personalwesen – also das Filtern, Bewerten oder Aussortieren von Bewerbern – fällt exakt in diese Hochrisiko-Kategorie.

Wenn dein Team solche Funktionen in alltäglicher Standard-Software nutzt, ohne dass es dafür klare, dokumentierte Leitplanken und ein tiefes Verständnis für die Risiken (Stichwort: Bias und Diskriminierung) gibt, schnappt die Falle zu.

Die Haftung für diesen unregulierten Einsatz trägt am Ende nicht der Software-Hersteller in den USA. Sie trägt auch nicht die überlastete Fachkraft, die eigentlich nur Zeit sparen wollte. Die Haftung landet direkt und ungebremst auf dem Schreibtisch der Geschäftsführung. Unwissenheit über die Funktionen der eigenen Büro-Software schützt ab August 2026 definitiv nicht mehr.

Vom Pflichtprogramm zur Lernreise: Der INQA-Ansatz

Die gute Nachricht ist: Du musst jetzt nicht in Panik verfallen und sämtliche KI-Tools im Betrieb sperren lassen. Das würde euch nur den Anschluss an den Markt kosten. Die Lösung liegt auch nicht darin, einen teuren Berater einzufliegen, der euch ein 100-seitiges Regelwerk auf den Tisch knallt, das am Ende niemand liest.

Was es jetzt braucht, ist der Wechsel von der passiven „Schulung“ hin zu einer aktiven Lernreise für das gesamte Team.

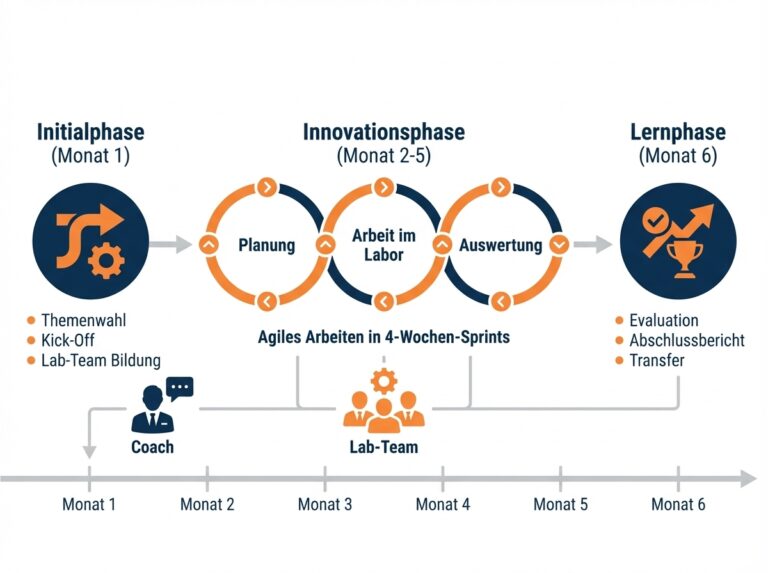

Genau hier setzt das INQA-Coaching an. Als zertifizierte Coaches stülpen wir euch keine fertigen, theoretischen Konzepte über. Wir etablieren stattdessen ein selbstorganisiertes Team aus eurer Mitte – quer durch alle Abteilungen. Dieses Team erarbeitet die Leitplanken für euren spezifischen Alltag selbst.

Wir stellen uns gemeinsam die entscheidenden Fragen:

- Der Radar: Welche KI-Funktionen schlummern bereits unbemerkt in unserer Standard-Software?

- Die Rote Linie: Bei welchen Aufgaben (wie dem Recruiting-Beispiel) ist der unprüfte Einsatz von KI ab sofort absolut tabu?

- Der Freiraum: Wo darf und soll die KI uns als Sparringspartner entlasten?

Wir agieren dabei als Strukturgeber und methodischer Begleiter. Das Ziel ist echte Hilfe zur Selbsthilfe: Euer Team wird befähigt, souverän, sicher und vor allem rechtssicher mit der neuen Technologie umzugehen. AI Literacy wird so von einer abstrakten Gesetzesvorgabe zu einer gelebten, internen Kompetenz.

Fokus: Agile Zusammenarbeit, „Lernreise“, ein diverses Team erarbeitet gemeinsam Lösungen.

Fazit: Das neue Betriebssystem für zukunftssichere Führung

Vergiss die Vorstellung, dass Künstliche Intelligenz ein reines IT-Projekt ist, das man mit einem Videokurs abhaken kann. AI Literacy ist die neue Kernkompetenz für das gesamte Betriebssystem deines Unternehmens. Wer jetzt die Augen verschließt und auf das Prinzip Hoffnung setzt, riskiert spätestens ab August 2026 nicht nur Bußgelder, sondern den Verlust der eigenen Handlungsfähigkeit.

Die Transformation der Arbeitswelt ist eine gewaltige Aufgabe, aber du musst sie nicht alleine stemmen. Weil der Aufbau dieser Kompetenzen im volkswirtschaftlichen Interesse liegt, wird das INQA-Coaching massiv staatlich gefördert – bis zu 80 Prozent der Beratungskosten können übernommen werden.

Lass uns die Elefantenherde im Raum gemeinsam ansprechen. Möchtest du wissen, wie eine geförderte Lernreise für dein Team konkret aussehen kann? Lass uns das in Ruhe besprechen.

Melde dich hier für ein kostenfreies, 15-minütiges Erstgespräch.